Las funciones de IA se han convertido en estándar en las apps de finanzas personales. Auto-categorización, análisis de gastos, sugerencias de presupuesto — la pregunta ya no es si tu app usa IA, sino dónde se ejecuta esa IA. Para la mayoría de las apps, la respuesta es: en un servidor remoto, con tus datos de transacciones enviados a través de la red para llegar allí.

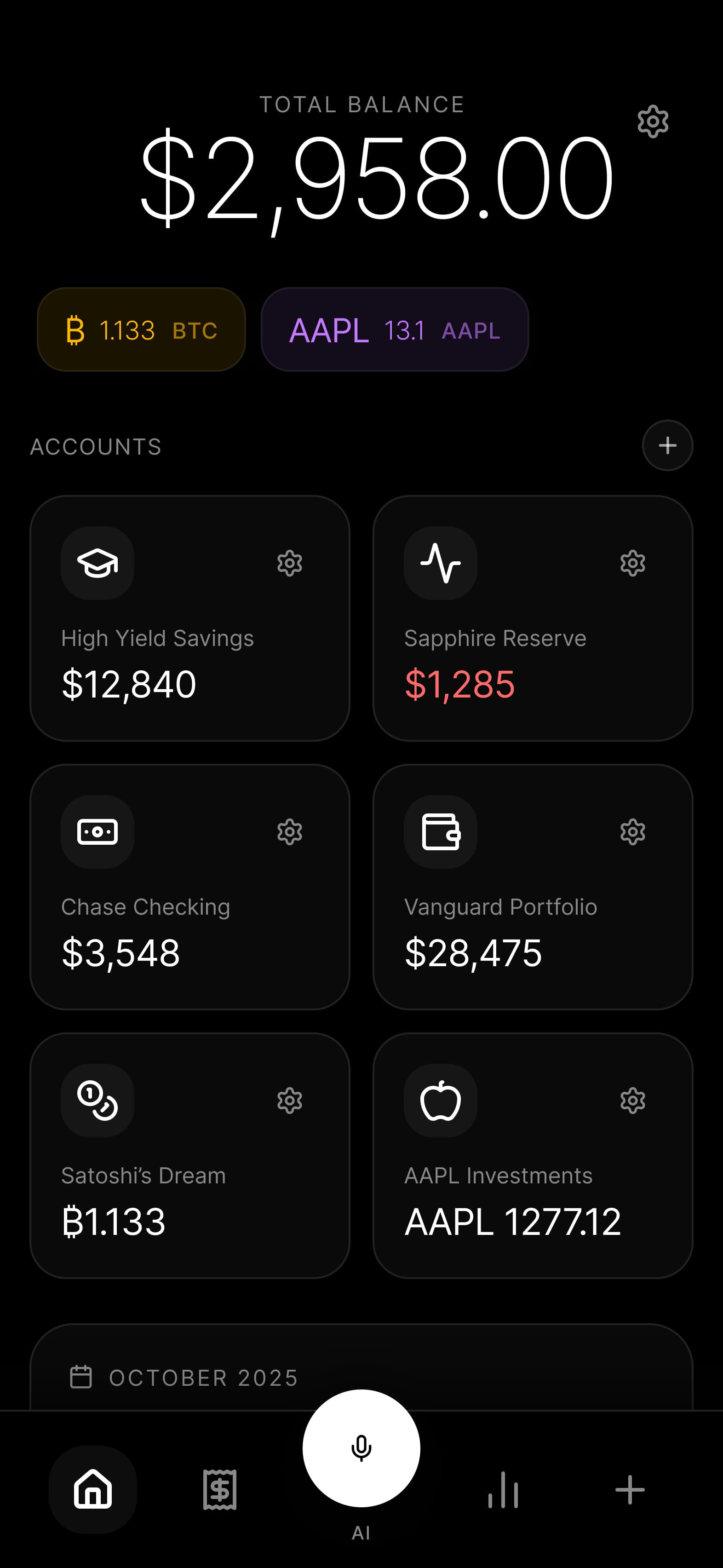

Budgie adopta un enfoque diferente. Cada función de IA — sugerencias de categorías, coincidencia de patrones basada en embeddings y entrada de transacciones por voz — se ejecuta completamente en tu dispositivo. Tus datos de gasto nunca salen de tu teléfono para el procesamiento de IA.

Este artículo explica qué significa técnicamente la IA en el dispositivo, por qué importa para la privacidad financiera y cómo Budgie la implementa de extremo a extremo.

¿Qué es la IA en el dispositivo?

La IA en el dispositivo significa que los pesos del modelo y la computación de inferencia viven en tu dispositivo — en RAM, usando tu CPU o hardware de motor neuronal — en lugar de en un servidor en la nube. Cuando pides una sugerencia de categoría, el modelo recibe tu entrada y produce la salida sin ninguna llamada de red.

IA en la nube vs IA en el dispositivo: la diferencia clave

- Asistentes de IA en la nube — La descripción de tu transacción, el nombre del comercio y el importe se serializan y envían a una API remota. El modelo se ejecuta en la infraestructura del proveedor, devuelve una respuesta y tus datos quedan registrados para monitoreo de calidad y seguridad.

- IA en el dispositivo — El modelo viene incluido con la aplicación (o se descarga una vez al configurarla). Cada llamada de inferencia permanece en tu dispositivo. Ninguna solicitud de red, ningún registro de servidor, ningún tercero ve jamás la entrada.

La contrapartida es el tamaño del modelo. Los proveedores de nube pueden ejecutar modelos de miles de millones de parámetros en clústeres de servidores sin restricciones de memoria o cómputo. Los modelos en el dispositivo deben caber en el presupuesto de memoria de un teléfono, lo que limita su tamaño. Las técnicas modernas de cuantización han cerrado dramáticamente esta brecha.

Por qué los datos financieros son lo peor que puedes enviar a la nube

Tu flujo de transacciones es uno de los conjuntos de datos más reveladores sobre ti. Revela dónde vives, dónde trabajas, qué condiciones médicas puedes tener, qué causas políticas apoyas y cómo son tus relaciones. Enviarlo a un servicio de IA remoto para su procesamiento tiene riesgos concretos:

- Registro de inferencias — La mayoría de los proveedores de IA en la nube registran las entradas para mejorar el modelo, revisión de seguridad y detección de abusos. Las descripciones de tus transacciones se convierten en datos de entrenamiento.

- Políticas de retención — Incluso con garantías de privacidad, los datos se retienen durante algún período. Las políticas cambian. Las adquisiciones ocurren. Lo que es privado hoy puede no serlo mañana.

- Perfilado agregado — Cuando millones de usuarios envían datos financieros similares al mismo servicio, el conjunto revela patrones de comportamiento que pueden monetizarse de formas que los formularios de consentimiento individuales no cubren claramente.

- Superficie de ataque — Cada servidor que almacena datos de usuarios es un objetivo potencial. El procesamiento en el dispositivo elimina completamente esta superficie para el componente de IA.

Cómo cabe un LLM de 1700 millones de parámetros en un teléfono

El núcleo de la categorización de IA de Budgie es un modelo de lenguaje de 1700 millones de parámetros. Hace unos años, ejecutar un modelo de este tamaño en un teléfono habría sido impracticable. Tres avances lo hicieron posible:

Cuantización

Los pesos del modelo de precisión completa se almacenan como flotantes de 32 bits, lo que significa que cada parámetro ocupa 4 bytes. La cuantización los reduce a enteros de 4 u 8 bits, reduciendo el modelo de 4x a 8x con una modesta pérdida de precisión. Un modelo de 1700 millones de parámetros cuantizado a 4 bits ocupa aproximadamente 900 MB — manejable en los smartphones modernos.

Aceleración con motor neuronal

Los procesadores Apple Silicon y los Android modernos incluyen hardware dedicado de procesamiento neuronal. Estos chips ejecutan multiplicaciones de matrices — el cómputo dominante en la inferencia de transformers — de forma mucho más eficiente que una CPU general. La inferencia que tomaría segundos en una CPU toma milisegundos en un motor neuronal.

Tiempos de ejecución de inferencia eficientes

Los tiempos de ejecución diseñados para la inferencia móvil gestionan la memoria, la tokenización y el procesamiento por lotes de formas optimizadas para entornos restringidos. Minimizan el uso máximo de memoria y mantienen la huella térmica lo suficientemente baja para el uso casual sin agotar la batería.

El resultado es que Budgie puede ejecutar un modelo de lenguaje capaz en segundo plano, sugerir una categoría en una fracción de segundo y hacerlo completamente sin conexión — sin latencia de red y sin costes de servidor.

Embeddings y LLM trabajando juntos: la pila de sugerencias en dos etapas

Budgie usa dos técnicas de IA complementarias para la categorización de transacciones. Abordan diferentes partes del problema y juntas producen sugerencias más precisas que cualquiera de los dos enfoques por separado.

Etapa 1: Coincidencia de patrones basada en embeddings

Cuando introduces una transacción por primera vez, Budgie convierte el nombre del comercio y la descripción en un embedding vectorial denso — una representación numérica que captura el significado semántico. Este embedding se compara con los embeddings de tus transacciones históricas usando similitud vectorial.

Si ya categorizaste transacciones del mismo comercio anteriormente, la coincidencia de embedding devuelve esas categorías con alta confianza. El modelo de embedding es pequeño y rápido — produce sugerencias en milisegundos y es especialmente bueno reconociendo comercios que ya has encontrado antes.

Etapa 2: Categorización semántica basada en LLM

Cuando la etapa de embedding produce resultados de baja confianza — por ejemplo, con un nuevo comercio o una descripción ambigua — el modelo de lenguaje completo toma el control. El LLM recibe la descripción de la transacción y tu lista de categorías como contexto, y genera una sugerencia clasificada.

El LLM es más lento que la búsqueda de embedding pero maneja bien las entradas novedosas. Entiende que un cargo de una farmacia debería ir bajo salud, incluso si nunca ha visto ese comercio específico antes, porque ha aprendido la relación semántica entre los tipos de comercios y las categorías de gasto.

Ambas etapas se ejecutan completamente en tu dispositivo. Los embeddings se almacenan localmente junto a tu base de datos de transacciones. Los pesos del LLM vienen incluidos con la app. Nada se envía a un endpoint remoto en ningún punto de este proceso.

Whisper.rn para voz: reconocimiento de voz sin conexión

Budgie admite entrada de transacciones por voz impulsada por Whisper.rn — un port React Native de OpenAI Whisper, el modelo de reconocimiento de voz de código abierto. Whisper se ejecuta completamente en el dispositivo. Cuando dices una transacción, el audio se procesa localmente y se transcribe sin enviarse a ninguna API de reconocimiento de voz.

Por qué esto importa para la privacidad

Los servicios de reconocimiento de voz en la nube reciben audio sin procesar. Ese audio puede contener más que solo la transacción que pretendes registrar — conversaciones de fondo, sonidos ambientales, información de identificación personal. Los proveedores de nube rutinariamente usan muestras de audio para mejorar sus modelos.

Whisper ejecutándose en tu dispositivo nunca envía audio a ningún lugar. El modelo recibe tu búfer de audio, produce una transcripción, y eso es el fin del flujo de datos. Sin registro de audio, sin llamada a API remota, sin terceros involucrados.

Cómo funciona el flujo de voz

- Tocas el botón de entrada por voz y dices los detalles de la transacción — importe, comercio y notas opcionales.

- Whisper transcribe el audio localmente, produciendo una cadena de texto.

- El texto transcrito se pasa a la pila de categorización en dos etapas descrita anteriormente.

- Budgie presenta un formulario de transacción prellenado con el importe extraído y la categoría sugerida para tu revisión antes de guardar.

Todo el flujo — desde el audio hasta la transacción guardada — ocurre sin conexión. Funciona en modo avión, en zonas sin señal y en cualquier idioma que Whisper admita.

Garantías de privacidad que puedes verificar en el código fuente

Budgie es de código abierto. Las declaraciones de privacidad realizadas en este artículo no son declaraciones de política — son hechos arquitectónicos visibles en el código fuente. Puedes verificar:

- Sin llamadas de red salientes durante la inferencia de IA — El servicio de categorización usa únicamente archivos de modelo locales y la base de datos SQLite local. No hay llamadas HTTP a endpoints de IA externos.

- Ningún dato de audio sale del dispositivo — El módulo de entrada por voz usa Whisper.rn con un archivo de modelo local. Los búferes de audio se procesan en memoria y se descartan tras la transcripción.

- Embeddings almacenados en SQLite local — Los vectores de embedding de tu historial de transacciones se almacenan en la misma base de datos cifrada que tus transacciones. No se sincronizan con ningún servidor.

- Sin telemetría sobre el uso de IA — Budgie no recopila análisis sobre qué funciones de IA usas, con qué frecuencia aceptas sugerencias o en qué categorías caen tus transacciones.

Si quieres auditar estas afirmaciones tú mismo, el código fuente está disponible públicamente. No tienes que fiarte de nuestra palabra.

Preguntas Frecuentes

¿La IA en el dispositivo significa que la categorización es menos precisa?

No de manera significativa para la categorización de gastos personales. La tarea está bien adaptada a modelos más pequeños: el vocabulario es limitado, la ventana de contexto es corta y tu historial personal de transacciones proporciona una señal previa sólida mediante embeddings. La pila de dos etapas de Budgie produce una precisión comparable a los enfoques en la nube para esta tarea específica.

¿Cuánto espacio de almacenamiento usan los modelos de IA?

El modelo de lenguaje y el modelo de embedding juntos requieren aproximadamente 900 MB a 1,2 GB de almacenamiento según el nivel de cuantización seleccionado durante la instalación. Esta es una descarga de una sola vez. Una vez instalados, no se requieren descargas adicionales de modelos para el uso normal.

¿La IA consume mi batería?

Budgie ejecuta la inferencia de IA solo cuando añades o editas una transacción — no de forma continua en segundo plano. Cada inferencia de categorización completa en menos de un segundo en hardware moderno. El impacto acumulado en la batería del uso diario normal es insignificante.

¿Puedo usar la entrada por voz en idiomas distintos al inglés?

Sí. Whisper admite más de 90 idiomas. La entrada por voz de Budgie funciona en cualquier idioma que Whisper admita, incluyendo conversaciones multilingües. La detección de idioma es automática.

¿Qué le pasa a las sugerencias de IA si estoy sin conexión?

Nada cambia. La IA en el dispositivo es inherentemente sin conexión. Todas las funciones de IA funcionan de forma idéntica tengas o no conectividad de red. Esta es una de las ventajas principales de la arquitectura.