Les fonctionnalités d'IA sont devenues standard dans les applications de finances personnelles. Catégorisation automatique, aperçus des dépenses, suggestions de budget — la question n'est plus de savoir si votre application utilise l'IA, mais où cette IA s'exécute. Pour la plupart des applications, la réponse est : sur un serveur distant, avec vos données de transactions envoyées sur le réseau pour y arriver.

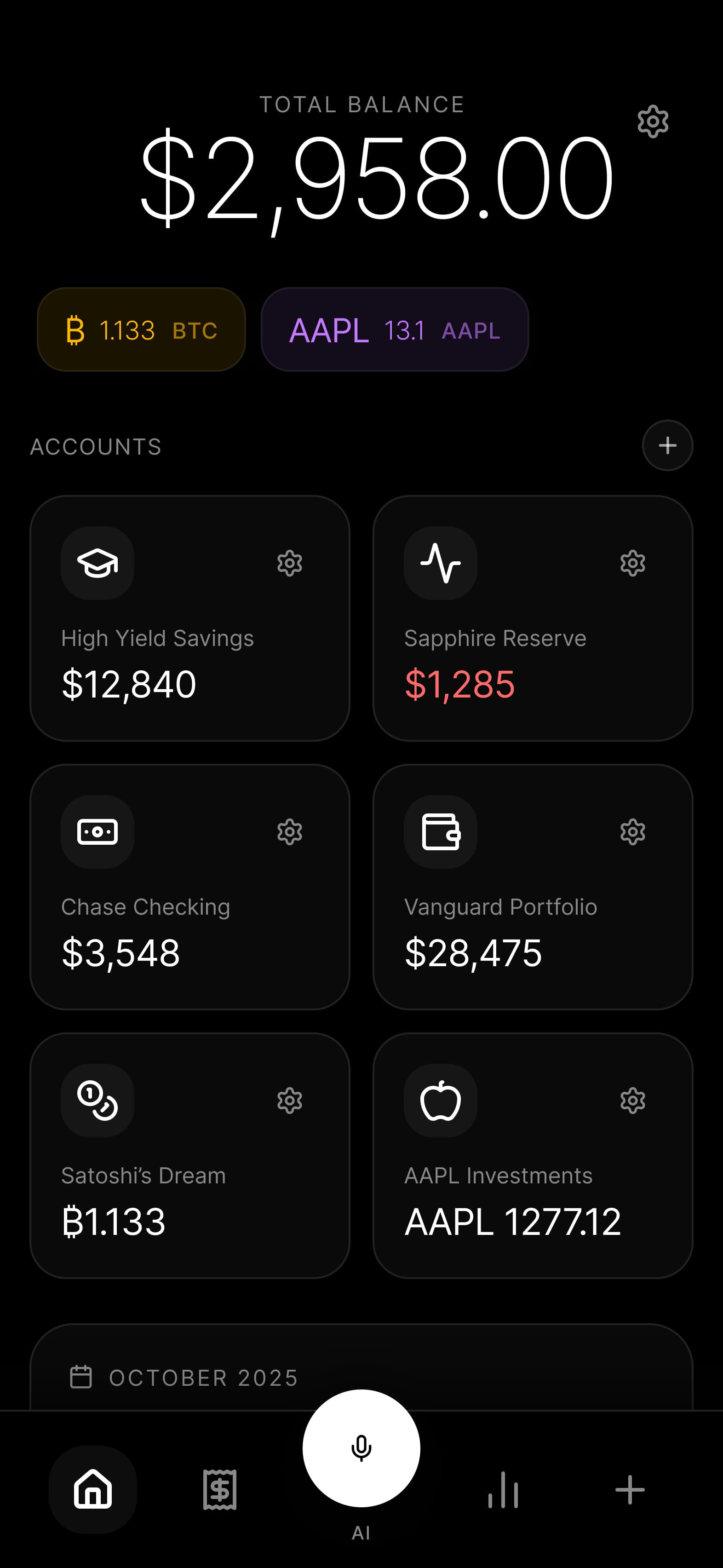

Budgie adopte une approche différente. Chaque fonctionnalité d'IA — suggestions de catégories, correspondance de motifs basée sur l'embedding et saisie vocale des transactions — s'exécute entièrement sur votre appareil. Vos données de dépenses ne quittent jamais votre téléphone pour le traitement par l'IA.

Cet article explique ce que l'IA sur l'appareil signifie techniquement, pourquoi c'est important pour la confidentialité financière et comment Budgie l'implémente de bout en bout.

Qu'est-ce que l'IA sur l'appareil ?

L'IA sur l'appareil signifie que les poids du modèle et le calcul d'inférence résident tous les deux sur votre appareil — en RAM, utilisant votre CPU ou le matériel de moteur neuronal — plutôt que sur un serveur cloud. Lorsque vous demandez une suggestion de catégorie, le modèle reçoit votre entrée et produit une sortie sans aucun appel réseau.

IA cloud vs IA sur l'appareil : la différence clé

- Assistants IA cloud — La description de votre transaction, le nom du commerçant et le montant sont sérialisés et envoyés à une API distante. Le modèle s'exécute sur l'infrastructure du fournisseur, renvoie une réponse, et vos données sont enregistrées à des fins de contrôle qualité et de sécurité.

- IA sur l'appareil — Le modèle est intégré à l'application (ou téléchargé une fois lors de la configuration). Chaque appel d'inférence reste sur votre appareil. Aucune requête réseau, aucun journal serveur, aucun tiers ne voit jamais l'entrée.

Le compromis est la taille du modèle. Les fournisseurs cloud peuvent faire tourner des modèles à des milliards de paramètres sur des clusters de serveurs sans contrainte de mémoire ou de calcul. Les modèles sur l'appareil doivent tenir dans le budget mémoire d'un téléphone, ce qui limite leur taille. Les techniques modernes de quantification ont considérablement réduit cet écart.

Pourquoi les données financières sont la pire chose à envoyer dans le cloud

Votre flux de transactions est l'un des ensembles de données les plus révélateurs sur vous. Il révèle où vous vivez, où vous travaillez, quelles conditions médicales vous pourriez avoir, quelles causes politiques vous soutenez et à quoi ressemblent vos relations. L'envoyer à un service IA distant pour traitement comporte des risques concrets :

- Journalisation de l'inférence — La plupart des fournisseurs d'IA cloud enregistrent les entrées à des fins d'amélioration du modèle, de révision de sécurité et de détection d'abus. Les descriptions de vos transactions deviennent des données d'entraînement.

- Politiques de conservation — Même avec des garanties de confidentialité, les données sont conservées pendant un certain temps. Les politiques changent. Les acquisitions se produisent. Ce qui est privé aujourd'hui ne le sera peut-être pas demain.

- Profilage agrégé — Lorsque des millions d'utilisateurs envoient des données financières similaires au même service, l'agrégat révèle des comportements pouvant être monétisés d'une façon que les formulaires de consentement individuels ne couvrent pas clairement.

- Surface de violation — Tout serveur contenant des données utilisateur est une cible potentielle. Le traitement sur l'appareil élimine entièrement cette surface pour le composant IA.

Comment un LLM de 1,7 milliard de paramètres tient sur un téléphone

Le cœur de la catégorisation IA de Budgie est un modèle de langage à 1,7 milliard de paramètres. Il y a quelques années, faire tourner un modèle de cette taille sur un téléphone aurait été impraticable. Trois avancées l'ont rendu possible :

Quantification

Les poids de modèle en pleine précision sont stockés en flottants 32 bits, ce qui signifie que chaque paramètre prend 4 octets. La quantisation réduit cela à des entiers 4 bits ou 8 bits, réduisant le modèle de 4x à 8x avec une perte de précision modeste. Un modèle de 1,7 milliard de paramètres quantisé en 4 bits occupe environ 900 Mo — gérable sur les smartphones modernes.

Accélération Neural Engine

Les puces Apple Silicon et les processeurs Android modernes incluent du matériel de traitement neuronal dédié. Ces puces exécutent les multiplications matricielles — le calcul dominant dans l'inférence des transformateurs — bien plus efficacement qu'un CPU classique. Une inférence qui prendrait des secondes sur un CPU prend des millisecondes sur un moteur neuronal.

Runtimes d'inférence efficaces

Les environnements d'exécution conçus pour l'inférence mobile gèrent la mémoire, la tokenisation et le traitement par lots de manière optimisée pour les environnements contraints. Ils minimisent l'utilisation maximale de la mémoire et maintiennent l'empreinte thermique suffisamment basse pour une utilisation quotidienne sans vider la batterie.

Le résultat est que Budgie peut exécuter un modèle de langage capable en arrière-plan, suggérer une catégorie en une fraction de seconde, et ce entièrement hors ligne — sans latence réseau ni coûts de serveur.

Embeddings et LLM travaillant ensemble : la pile de suggestions en deux étapes

Budgie utilise deux techniques d'IA complémentaires pour la catégorisation des transactions. Elles traitent différentes parties du problème et ensemble produisent des suggestions plus précises que l'une ou l'autre approche seule.

Étape 1 : Correspondance de motifs par embedding

Lorsque vous saisissez une transaction pour la première fois, Budgie convertit le nom du marchand et la description en un embedding vectoriel dense — une représentation numérique qui capture le sens sémantique. Cet embedding est comparé aux embeddings de vos transactions historiques en utilisant la similarité vectorielle.

Si vous avez précédemment catégorisé des transactions du même commerçant, la correspondance d'embedding renvoie ces catégories avec une grande confiance. Le modèle d'embedding est petit et rapide — il produit des suggestions en millisecondes et est particulièrement bon pour reconnaître les commerçants que vous avez rencontrés auparavant.

Étape 2 : Catégorisation sémantique par LLM

Lorsque l'étape d'embedding produit des résultats à faible confiance — par exemple, avec un nouveau marchand ou une description ambiguë — le modèle de langage complet prend le relais. Le LLM reçoit la description de la transaction et votre liste de catégories comme contexte, et génère une suggestion classée.

Le LLM est plus lent que la recherche par embedding mais gère bien les nouvelles entrées. Il comprend qu'un achat dans une pharmacie doit aller sous santé, même s'il n'a jamais vu ce marchand spécifique auparavant, car il a appris la relation sémantique entre les types de marchands et les catégories de dépenses.

Les deux étapes s'exécutent entièrement sur votre appareil. Les embeddings sont stockés localement aux côtés de votre base de données de transactions. Les poids du LLM sont inclus dans l'application. Rien n'est envoyé à un point de terminaison distant à aucun moment de ce pipeline.

Whisper.rn pour la voix : Reconnaissance vocale hors ligne

Budgie prend en charge la saisie vocale des transactions alimentée par Whisper.rn — un port React Native d'OpenAI Whisper, le modèle de reconnaissance vocale open source. Whisper s'exécute entièrement sur l'appareil. Lorsque vous dictez une transaction, l'audio est traité localement et transcrit sans être envoyé à aucune API de reconnaissance vocale.

Pourquoi c'est important pour la confidentialité

Les services de reconnaissance vocale cloud reçoivent l'audio brut. Cet audio peut contenir plus que la seule transaction que vous souhaitez enregistrer — conversations en arrière-plan, sons ambiants, informations personnellement identifiables. Les fournisseurs cloud utilisent régulièrement des échantillons audio pour améliorer leurs modèles.

Whisper s'exécutant sur votre appareil n'envoie jamais l'audio nulle part. Le modèle reçoit votre tampon audio, produit une transcription, et c'est la fin du flux de données. Aucun journal audio, aucun appel API distant, aucun tiers impliqué.

Comment fonctionne le flux vocal

- Vous touchez le bouton de saisie vocale et énoncez les détails de la transaction — montant, marchand et notes optionnelles.

- Whisper transcrit l'audio localement, produisant une chaîne de texte.

- Le texte transcrit est transmis au pipeline de catégorisation en deux étapes décrit ci-dessus.

- Budgie présente un formulaire de transaction pré-rempli avec le montant extrait et la catégorie suggérée pour votre révision avant la sauvegarde.

L'ensemble du flux — de l'audio à la transaction enregistrée — se déroule hors ligne. Cela fonctionne en mode avion, dans les zones sans signal et dans n'importe quelle langue prise en charge par Whisper.

Garanties de confidentialité vérifiables dans le code source

Budgie est open source. Les déclarations de confidentialité faites dans cet article ne sont pas des déclarations de politique — ce sont des faits architecturaux visibles dans le code source. Vous pouvez vérifier :

- Aucun appel réseau sortant lors de l'inférence IA — Le service de catégorisation utilise uniquement des fichiers de modèle locaux et la base de données SQLite locale. Il n'y a aucun appel HTTP vers des points de terminaison IA externes.

- Aucune donnée audio ne quitte l'appareil — Le module de saisie vocale utilise Whisper.rn avec un fichier de modèle local. Les tampons audio sont traités en mémoire et supprimés après la transcription.

- Embeddings stockés dans SQLite local — Les vecteurs d'embedding de votre historique de transactions sont stockés dans la même base de données chiffrée que vos transactions. Ils ne sont synchronisés avec aucun serveur.

- Aucune télémétrie sur l'utilisation de l'IA — Budgie ne collecte aucune analyse sur les fonctionnalités IA que vous utilisez, la fréquence à laquelle vous acceptez des suggestions ou les catégories dans lesquelles tombent vos transactions.

Si vous souhaitez auditer ces déclarations vous-même, le code source est publiquement disponible. Vous n'avez pas à nous croire sur parole.

Foire aux questions

L'IA sur l'appareil signifie-t-elle que la catégorisation est moins précise ?

Pas de manière significative pour la catégorisation des dépenses personnelles. La tâche est bien adaptée aux modèles plus petits : le vocabulaire est limité, la fenêtre de contexte est courte, et votre historique de transactions personnel fournit un signal préalable fort via les embeddings. La pile à deux étages de Budgie produit une précision comparable aux approches cloud pour cette tâche spécifique.

Quelle quantité de stockage les modèles IA utilisent-ils ?

Le modèle de langage et le modèle d'embedding nécessitent ensemble environ 900 Mo à 1,2 Go de stockage selon le niveau de quantification sélectionné lors de l'installation. C'est un téléchargement unique. Une fois installés, aucun téléchargement supplémentaire de modèle n'est requis pour une utilisation normale.

L'IA consomme-t-elle ma batterie ?

Budgie exécute l'inférence IA uniquement lorsque vous ajoutez ou modifiez une transaction — pas en continu en arrière-plan. Chaque inférence de catégorisation se termine en moins d'une seconde sur le matériel moderne. L'impact cumulatif sur la batterie d'une utilisation quotidienne normale est négligeable.

Puis-je utiliser la saisie vocale dans des langues autres que l'anglais ?

Oui. Whisper prend en charge plus de 90 langues. La saisie vocale de Budgie fonctionne dans n'importe quelle langue prise en charge par Whisper, y compris les conversations multilingues. La détection de la langue est automatique.

Que se passe-t-il avec les suggestions IA si je suis hors ligne ?

Rien ne change. L'IA sur l'appareil est intrinsèquement hors ligne. Toutes les fonctionnalités IA fonctionnent de manière identique que vous ayez ou non une connectivité réseau. C'est l'un des avantages fondamentaux de l'architecture.