KI-Funktionen sind zum Standard in persönlichen Finanz-Apps geworden. Automatische Kategorisierung, Ausgabeneinblicke, Budgetvorschläge – die Frage ist nicht mehr, ob Ihre App KI verwendet, sondern wo diese KI läuft. Für die meisten Apps lautet die Antwort: auf einem Remote-Server, mit Ihren Transaktionsdaten, die über das Netzwerk dorthin gesendet werden.

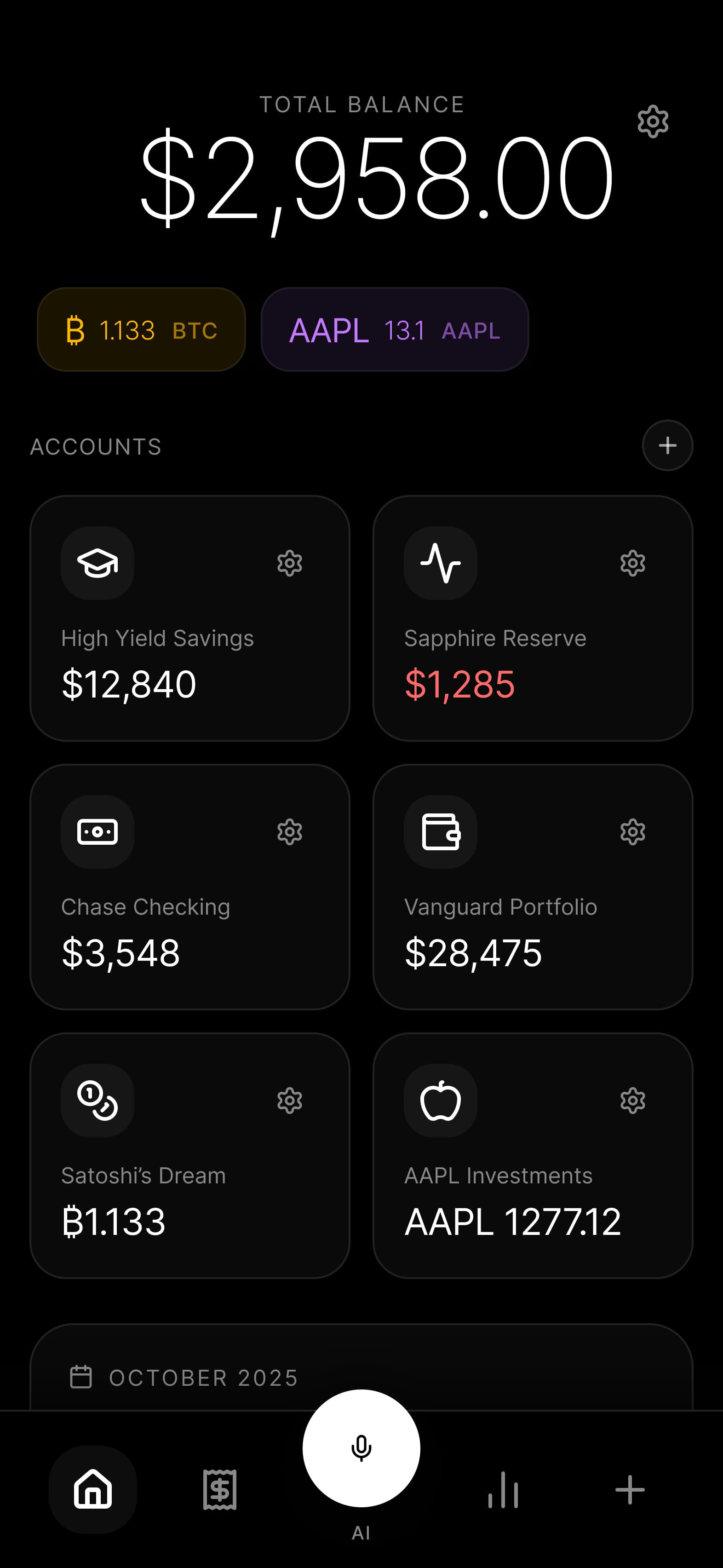

Budgie verfolgt einen anderen Ansatz. Jede KI-Funktion – Kategorievorschläge, embedding-basiertes Mustererkennen und Sprach-Transaktionseingabe – läuft vollständig auf Ihrem Gerät. Ihre Ausgabendaten verlassen Ihr Smartphone nie zur KI-Verarbeitung.

Dieser Artikel erklärt, was geräteeigene KI technisch bedeutet, warum sie für finanzielle Privatsphäre wichtig ist und wie Budgie sie von Anfang bis Ende implementiert.

Was ist geräteeigene KI?

Geräteeigene KI bedeutet, dass die Modellgewichte und die Inferenzberechnung beide auf Ihrem Gerät leben – im RAM, mit Ihrer CPU oder Neural-Engine-Hardware – anstatt auf einem Cloud-Server. Wenn Sie einen Kategorievorschlag anfordern, empfängt das Modell Ihre Eingabe und produziert eine Ausgabe ohne Netzwerkaufruf.

Cloud-KI vs. geräteeigene KI: Der entscheidende Unterschied

- Cloud-KI-Assistenten — Ihre Transaktionsbeschreibung, der Händlername und der Betrag werden serialisiert und an eine Remote-API gesendet. Das Modell läuft auf der Infrastruktur des Anbieters, gibt eine Antwort zurück, und Ihre Daten werden zur Qualitäts- und Sicherheitsüberwachung protokolliert.

- KI auf dem Gerät — Das Modell ist in der App gebündelt (oder wird einmalig bei der Einrichtung heruntergeladen). Jeder Inferenzaufruf bleibt auf Ihrem Gerät. Keine Netzwerkanfrage, kein Serverprotokoll, keine dritte Partei sieht je die Eingabe.

Der Kompromiss liegt in der Modellgröße. Cloud-Anbieter können Milliarden-Parameter-Modelle auf Serverclustern ohne Einschränkung bei Speicher oder Rechenleistung ausführen. Geräteeigene Modelle müssen in das Speicherbudget eines Smartphones passen, was ihre Größe begrenzt. Moderne Quantisierungstechniken haben diese Lücke dramatisch verkleinert.

Warum Finanzdaten das Schlimmste sind, was man in die Cloud senden kann

Ihr Transaktionsstrom ist einer der aufschlussreichsten Datensätze über Sie. Er offenbart, wo Sie leben, wo Sie arbeiten, welche medizinischen Zustände Sie haben könnten, welche politischen Anliegen Sie unterstützen und wie Ihre Beziehungen aussehen. Das Senden an einen Remote-KI-Dienst zur Verarbeitung hat konkrete Risiken:

- Inferenz-Protokollierung — Die meisten Cloud-KI-Anbieter protokollieren Eingaben zur Modellverbesserung, Sicherheitsüberprüfung und Missbrauchserkennung. Ihre Transaktionsbeschreibungen werden zu Trainingsdaten.

- Aufbewahrungsrichtlinien — Selbst mit Datenschutzgarantien werden Daten für einen gewissen Zeitraum aufbewahrt. Richtlinien ändern sich. Übernahmen geschehen. Was heute privat ist, muss morgen nicht mehr privat sein.

- Aggregiertes Profiling — Wenn Millionen von Nutzern ähnliche Finanzdaten an denselben Dienst senden, offenbart die Gesamtheit Verhaltensmuster, die auf Weisen monetarisiert werden können, die individuelle Einwilligungsformulare nicht klar abdecken.

- Angriffsfläche für Datenpannen — Jeder Server, der Nutzerdaten enthält, ist ein potenzielles Angriffsziel. Die Verarbeitung auf dem Gerät eliminiert diese Fläche vollständig für die KI-Komponente.

Wie ein 1,7-Mrd.-Parameter-LLM auf ein Smartphone passt

Der Kern der Budgie-KI-Kategorisierung ist ein Sprachmodell mit 1,7 Milliarden Parametern. Vor einigen Jahren wäre es unpraktisch gewesen, ein Modell dieser Größe auf einem Smartphone zu betreiben. Drei Fortschritte haben es möglich gemacht:

Quantisierung

Vollpräzisions-Modellgewichte werden als 32-Bit-Floats gespeichert, was bedeutet, dass jeder Parameter 4 Bytes belegt. Quantisierung reduziert dies auf 4-Bit- oder 8-Bit-Integer, was das Modell um das 4- bis 8-Fache schrumpft bei bescheidenem Genauigkeitsverlust. Ein auf 4-Bit quantisiertes 1,7-Mrd.-Parameter-Modell belegt etwa 900 MB – handhabbar auf modernen Smartphones.

Neural-Engine-Beschleunigung

Apple Silicon und moderne Android-Prozessoren verfügen über dedizierte neuronale Verarbeitungshardware. Diese Chips führen Matrixmultiplikationen – die dominante Berechnung bei Transformer-Inferenz – weitaus effizienter aus als eine allgemeine CPU. Inferenz, die auf einer CPU Sekunden dauern würde, dauert auf einem neuronalen Prozessor Millisekunden.

Effiziente Inferenz-Runtimes

Für mobile Inferenz entworfene Runtimes handhaben Speicherverwaltung, Tokenisierung und Batching in einer für eingeschränkte Umgebungen optimierten Weise. Sie minimieren den Spitzenspeicherverbrauch und halten den Wärmefußabdruck niedrig genug für gelegentliche Nutzung ohne Akkuverbrauch.

Das Ergebnis ist, dass Budgie ein leistungsfähiges Sprachmodell im Hintergrund ausführen, eine Kategorie in einem Bruchteil einer Sekunde vorschlagen und dies vollständig offline tun kann – ohne Netzwerklatenz und ohne Serverkosten.

Embeddings und LLM zusammen: Der zweistufige Vorschlagsstapel

Budgie verwendet zwei komplementäre KI-Techniken für die Transaktionskategorisierung. Sie adressieren unterschiedliche Teile des Problems und erzeugen zusammen genauere Vorschläge als jeder Ansatz allein.

Phase 1: Embedding-basiertes Mustererkennen

Wenn Sie zum ersten Mal eine Transaktion eingeben, wandelt Budgie den Händlernamen und die Beschreibung in ein dichtes Vektor-Embedding um – eine numerische Darstellung, die semantische Bedeutung erfasst. Dieses Embedding wird mit Embeddings Ihrer historischen Transaktionen über Vektorähnlichkeit verglichen.

Wenn Sie zuvor Transaktionen desselben Händlers kategorisiert haben, gibt der Embedding-Match diese Kategorien mit hoher Sicherheit zurück. Das Embedding-Modell ist klein und schnell – es produziert Vorschläge in Millisekunden und ist besonders gut darin, Händler zu erkennen, denen Sie zuvor begegnet sind.

Phase 2: LLM-basierte semantische Kategorisierung

Wenn die Embedding-Phase Ergebnisse mit niedriger Konfidenz produziert – zum Beispiel bei einem neuen Händler oder einer mehrdeutigen Beschreibung – übernimmt das vollständige Sprachmodell. Das LLM empfängt die Transaktionsbeschreibung und Ihre Kategorieliste als Kontext und generiert einen priorisierten Vorschlag.

Das LLM ist langsamer als der Embedding-Lookup, behandelt aber neue Eingaben gut. Es versteht, dass eine Belastung einer Apotheke unter Gesundheit gehen sollte, selbst wenn es diesen spezifischen Händler noch nie gesehen hat, weil es die semantische Beziehung zwischen Händlertypen und Ausgabenkategorien erlernt hat.

Beide Phasen laufen vollständig auf Ihrem Gerät. Die Embeddings werden lokal neben Ihrer Transaktionsdatenbank gespeichert. Die LLM-Gewichte sind in der App gebündelt. Nichts wird in dieser Pipeline an einen Remote-Endpunkt gesendet.

Whisper.rn für Sprache: Offline-Spracherkennungs-Text

Budgie unterstützt Sprach-Transaktionseingabe auf Basis von Whisper.rn – einem React Native-Port von OpenAI Whisper, dem Open-Source-Spracherkennungsmodell. Whisper läuft vollständig auf dem Gerät. Wenn Sie eine Transaktion sprechen, wird das Audio lokal verarbeitet und transkribiert, ohne an eine Spracherkennungs-API gesendet zu werden.

Warum das für den Datenschutz wichtig ist

Cloud-Spracherkennungsdienste empfangen rohe Audiodaten. Diese Audiodaten können mehr enthalten als nur die Transaktion, die Sie aufzeichnen möchten – Hintergrundgespräche, Umgebungsgeräusche, persönlich identifizierende Informationen. Cloud-Anbieter verwenden routinemäßig Audioproben zur Verbesserung ihrer Modelle.

Whisper, das auf Ihrem Gerät läuft, sendet Audio nirgendwo hin. Das Modell empfängt Ihren Audiopuffer, produziert ein Transkript, und das ist das Ende des Datenflusses. Kein Audioprotokoll, kein Remote-API-Aufruf, keine dritte Partei beteiligt.

Wie der Sprach-Ablauf funktioniert

- Sie tippen auf die Spracheingabetaste und sprechen die Transaktionsdetails – Betrag, Händler und optionale Notizen.

- Whisper transkribiert das Audio lokal und produziert eine Textzeichenkette.

- Der transkribierte Text wird an den oben beschriebenen zweistufigen Kategorisierungsstapel weitergegeben.

- Budgie präsentiert ein vorausgefülltes Transaktionsformular mit dem extrahierten Betrag und der vorgeschlagenen Kategorie zur Überprüfung, bevor es gespeichert wird.

Der gesamte Ablauf – von Audio bis zur gespeicherten Transaktion – geschieht offline. Es funktioniert im Flugmodus, in Gebieten ohne Signal und in jeder Sprache, die Whisper unterstützt.

Datenschutzgarantien, die Sie im Quellcode überprüfen können

Budgie ist Open Source. Die in diesem Artikel gemachten Datenschutzaussagen sind keine Richtlinienaussagen – sie sind architektonische Fakten, die im Quellcode sichtbar sind. Sie können verifizieren:

- Keine ausgehenden Netzwerkanrufe während der KI-Inferenz — Der Kategorisierungsdienst verwendet nur lokale Modelldateien und die lokale SQLite-Datenbank. Es gibt keine HTTP-Aufrufe an externe KI-Endpunkte.

- Keine Audiodaten verlassen das Gerät — Das Spracheingabemodul verwendet Whisper.rn mit einer lokalen Modelldatei. Audiopuffer werden im Arbeitsspeicher verarbeitet und nach der Transkription verworfen.

- Embeddings in lokalem SQLite gespeichert — Die Embedding-Vektoren Ihrer Transaktionshistorie sind in derselben verschlüsselten Datenbank wie Ihre Transaktionen gespeichert. Sie werden nicht mit einem Server synchronisiert.

- Keine Telemetrie zur KI-Nutzung — Budgie sammelt keine Analysen darüber, welche KI-Funktionen Sie nutzen, wie oft Sie Vorschläge akzeptieren oder in welche Kategorien Ihre Transaktionen fallen.

Wenn Sie diese Aussagen selbst überprüfen möchten, ist der Quellcode öffentlich verfügbar. Sie müssen uns nicht beim Wort nehmen.

Häufig gestellte Fragen

Bedeutet geräteeigene KI, dass die Kategorisierung weniger genau ist?

Nicht nennenswert für die persönliche Ausgabenkategorisierung. Die Aufgabe ist für kleinere Modelle gut geeignet: Das Vokabular ist begrenzt, das Kontextfenster ist kurz, und Ihre persönliche Transaktionshistorie liefert ein starkes Vorzeichen-Signal über Embeddings. Budgies zweistufiger Stack erzeugt für diese spezifische Aufgabe eine Genauigkeit vergleichbar mit Cloud-Ansätzen.

Wie viel Speicher verwenden die KI-Modelle?

Das Sprachmodell und das Embedding-Modell benötigen zusammen etwa 900 MB bis 1,2 GB Speicher, abhängig vom bei der Installation gewählten Quantisierungsgrad. Dies ist ein einmaliger Download. Nach der Installation sind für die normale Nutzung keine weiteren Modell-Downloads erforderlich.

Verbraucht die KI meinen Akku?

Budgie führt KI-Inferenz nur durch, wenn Sie eine Transaktion hinzufügen oder bearbeiten – nicht kontinuierlich im Hintergrund. Jede Kategorisierungsinferenz wird auf moderner Hardware in unter einer Sekunde abgeschlossen. Der kumulative Akkuverbrauch bei normalem täglichem Gebrauch ist vernachlässigbar.

Kann ich Spracheingabe in anderen Sprachen als Englisch nutzen?

Ja. Whisper unterstützt über 90 Sprachen. Budgies Spracheingabe funktioniert in jeder Sprache, die Whisper unterstützt, einschließlich mehrsprachiger Gespräche. Spracherkennung ist automatisch.

Was passiert mit KI-Vorschlägen, wenn ich offline bin?

Nichts ändert sich. Geräteeigene KI ist von Natur aus offline. Alle KI-Funktionen funktionieren identisch, ob Sie Netzwerkkonnektivität haben oder nicht. Dies ist einer der Kernvorteile der Architektur.